Contexto

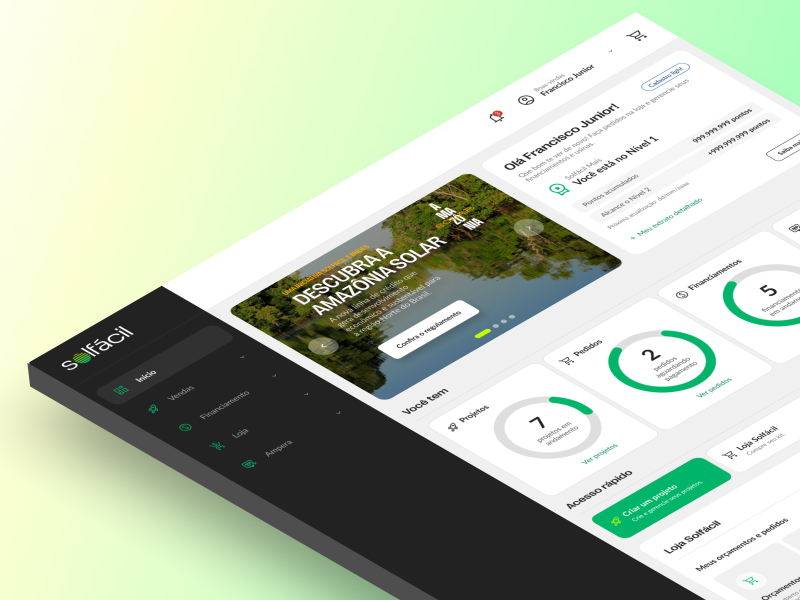

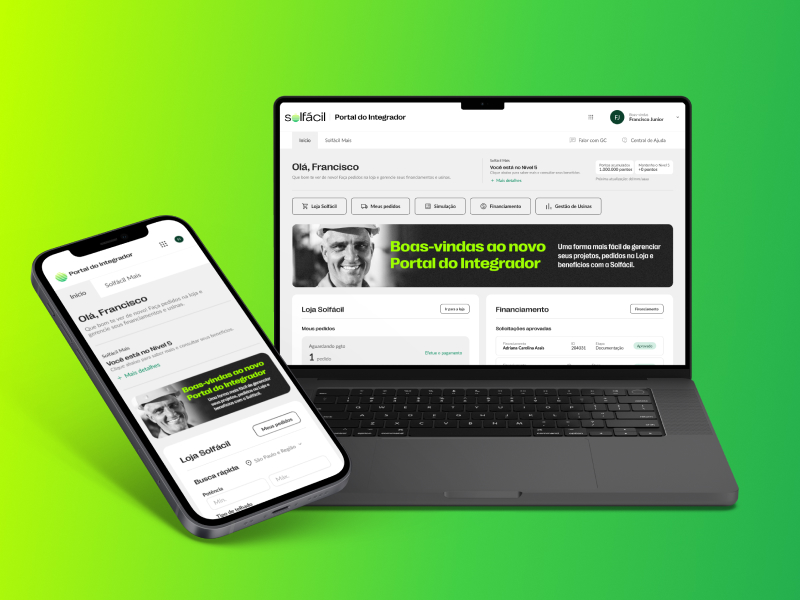

O Ampera é um dos produtos do ecossistema digital da Solfácil, voltado especificamente para o monitoramento e análise do desempenho energético dos sistemas solares instalados pelos parceiros integradores em seus clientes finais.

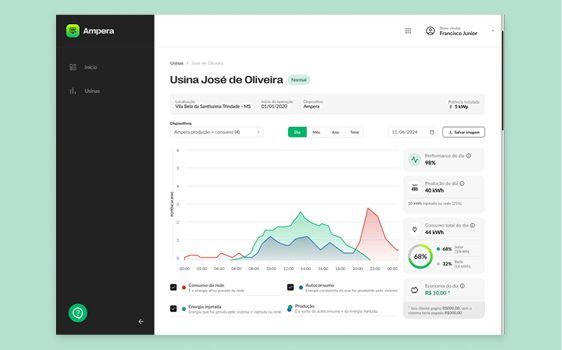

Enquanto outras soluções da Solfácil suportam etapas como viabilização financeira e aquisição de equipamentos, o Ampera atua no pós-instalação/venda, oferecendo aos integradores visibilidade sobre produção, consumo e comportamento energético ao longo do tempo. É por meio da plataforma que o integrador acompanha a performance do sistema, identifica desvios, avalia oportunidades de otimização e sustenta conversas técnicas, comerciais e realiza o pós-venda com seus clientes.A plataforma Ampera vinha evoluindo em paralelo ao aperfeiçoamento do dispositivo medidor de consumo Ampera, que passava por uma nova versão de hardware.

Enquanto a versão anterior do dispositivo permitia apenas a leitura de dados de produção e performance do sistema, a nova geração ampliava significativamente o volume e a granularidade das informações capturadas.

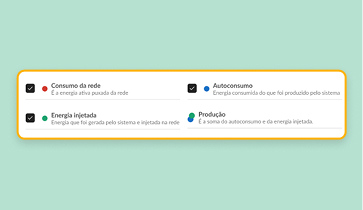

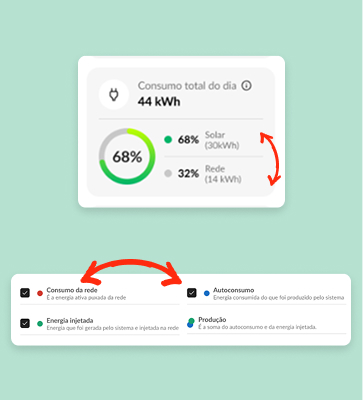

Com o novo dispositivo, integradores passariam a ter acesso a dados de consumo da rede, autoconsumo, energia injetada e consumo total, permitindo uma análise mais profunda do comportamento energético dos clientes finais. Essa ampliação habilitava novos tipos de diagnóstico, como identificar ineficiências no uso da energia gerada, avaliar dependência da rede elétrica e apoiar decisões técnicas e comerciais mais precisas.

Do ponto de vista da experiência, essa evolução representava uma mudança relevante: a plataforma deixava de ser apenas um painel informativo de produção para se tornar uma ferramenta analítica, exigindo do usuário maior capacidade de interpretação, comparação e entendimento conceitual dos dados apresentados.

Esse aumento de complexidade cognitiva trouxe riscos claros de usabilidade e compreensão. Por esse motivo, identifiquei a necessidade de validar a proposta de interface antes de avançar para desenvolvimento, garantindo que os integradores conseguissem interpretar corretamente os novos dados e extrair valor real da experiência.

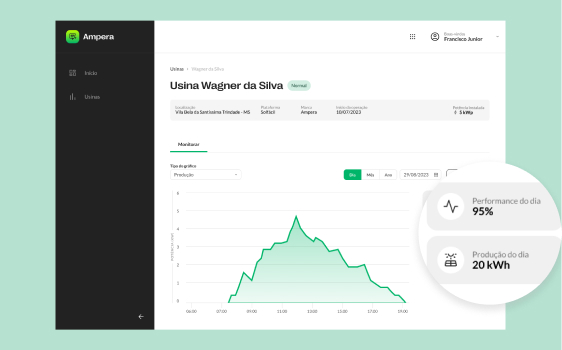

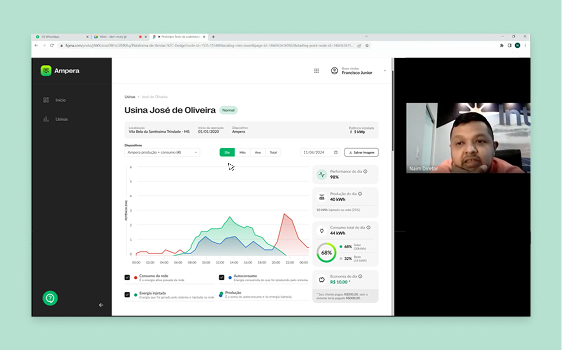

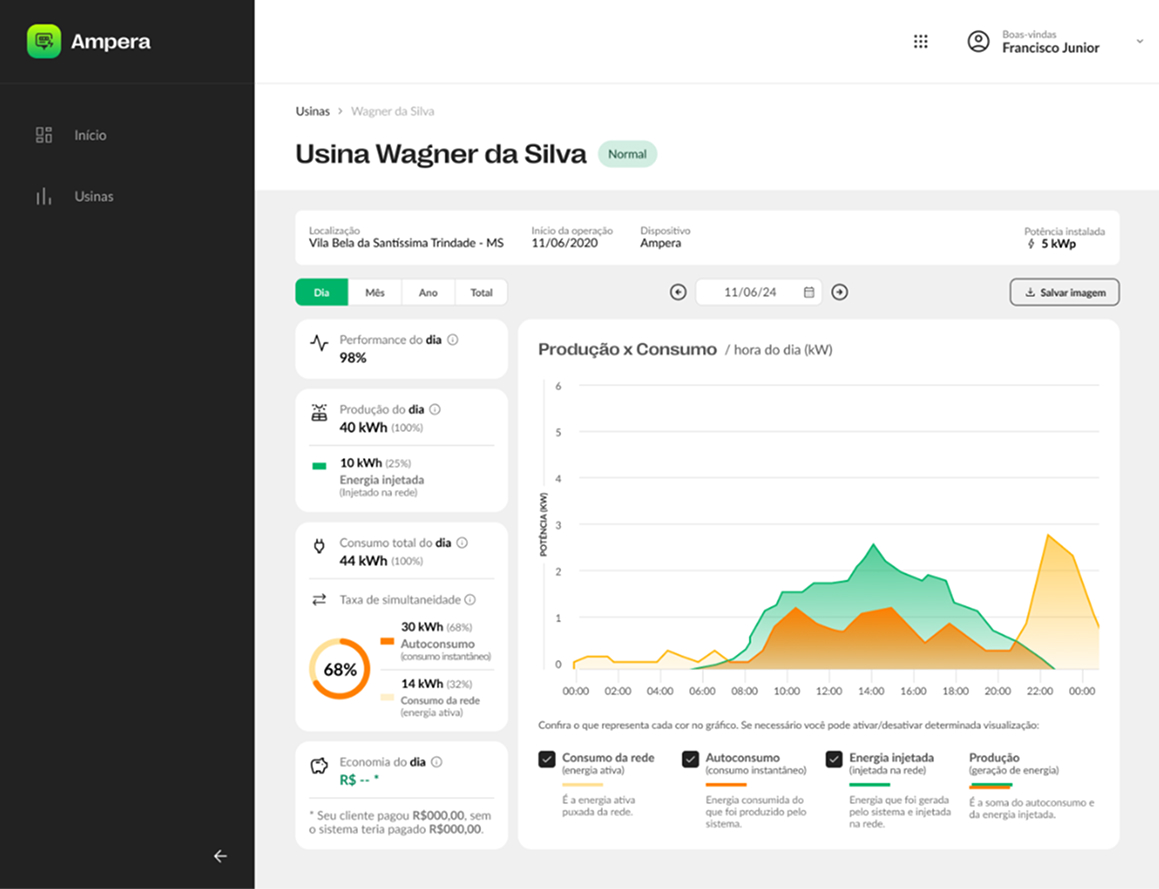

Tela do detalhe da usina com dados diário de performance e produção do antigo medidor de consumo.

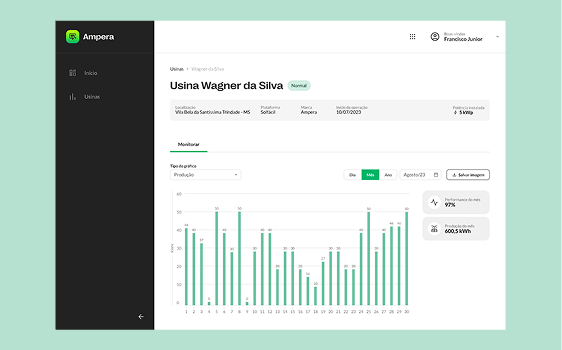

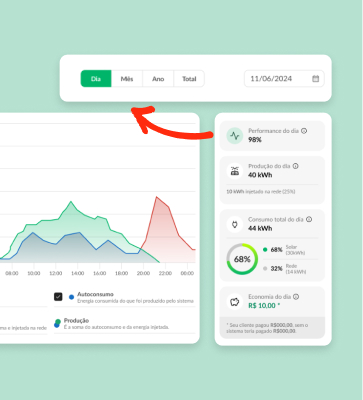

Visualização dos dados mensais de produção.

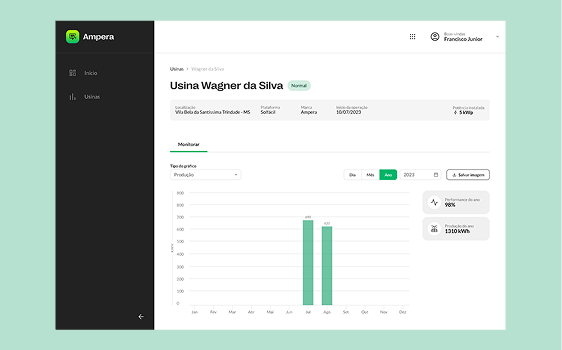

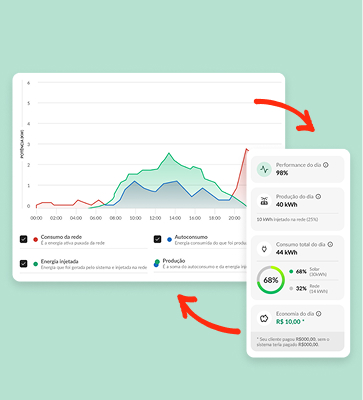

Visualização dos dados anuais de produção.

- Interpretar corretamente produção vs. consumo;

- Diferenciar autoconsumo de consumo da rede;

- Relacionar gráficos, filtros e cards de resumo;

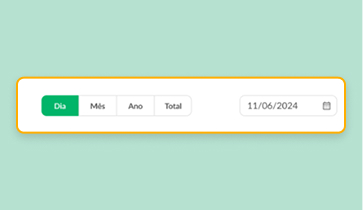

- Navegar entre períodos temporais sem ambiguidades.

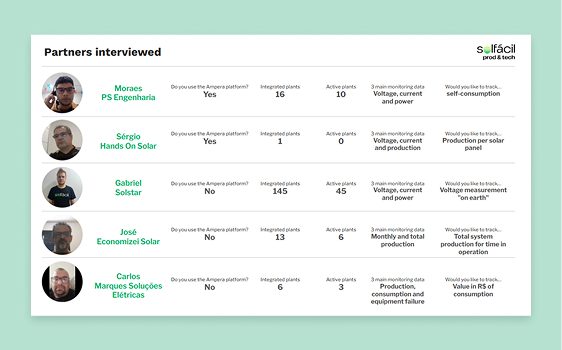

5 integradores com diferentes níveis de maturidade técnica

Protótipo funcional com dados de produção e consumo

Teste de usabilidade moderado, remoto

Roteiro semiestruturado

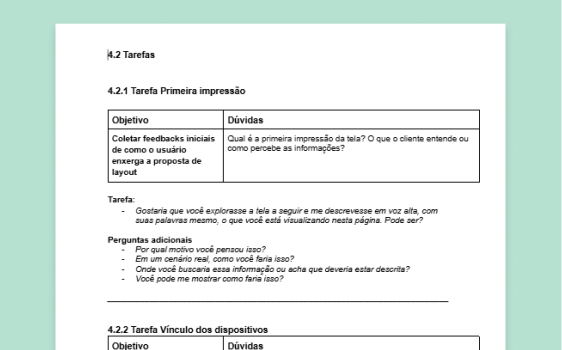

Roteiro criado com 9 tarefas sendo destas 4 tarefas críticas relacionadas à leitura e interpretação de dados

Coleta de dados via:

- Task success;

- Observação de erros;

- Fricções comportamentais;

- Capacidade de verbalização correta.

- Total de execuções analisadas:

45 execuções (5 usuários × 9 tarefas)

Planilha de tabulação dos dados da pesquisa, com transcrição de fricções, feedbacks dos participantes e avaliações que foi preenchida de forma colaborativa entre os designers, PMs e desenvolvedores que participaram como observadores durante as aplicações dos testes.

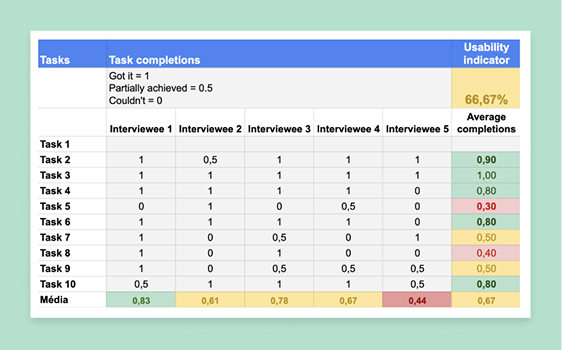

1. Task Success Rate (interpretação correta)

O teste de usabilidade avaliou a capacidade dos integradores de localizar, interpretar e relacionar dados energéticos apresentados na plataforma, especialmente em cenários que exigiam leitura analítica e tomada de decisão. As tarefas envolveram a interpretação de consumo da rede elétrica, leitura e entendimento de autoconsumo (total, mensal e anual) e a compreensão da relação entre gráficos, filtros de período e valores apresentados.

Resultado consolidado

Considerando todas as execuções das tarefas avaliadas, os resultados indicaram um task success efetivo de aproximadamente 60%, distribuído da seguinte forma:

- 45% de sucesso completo

O participante concluiu a tarefa corretamente, sem hesitação; - 30% de sucesso parcial

A tarefa foi concluída, mas com dúvidas, correções ou necessidade de confirmação; - 25% de falha ou interpretação incorreta

O participante não conseguiu interpretar corretamente o dado solicitado.

Relatório Task Success Rate

Esses números indicam que, embora parte das tarefas tenha sido concluída, uma parcela relevante dos usuários apresentou dificuldade em compreender os dados com segurança.

Leitura comparativa entre tipos de tarefa

Ao analisar o desempenho por tipo de tarefa, observou-se um padrão consistente:

- Tarefas de leitura direta, como produção de energia ou valores financeiros já consolidados, apresentaram alto desempenho, com médias iguais ou superiores a 0,80.

- Tarefas analíticas, que exigiam interpretação conceitual — como performance do sistema, consumo desagregado (rede vs. autoconsumo) e agregações temporais — apresentaram desempenho significativamente inferior, com médias entre 0,30 e 0,50.

O contraste entre tarefas de leitura e analíticas evidencia que o principal desafio não estava em encontrar informações, mas em compreender corretamente o significado e a relação entre os dados apresentados.

Interpretação dos resultados

Os resultados apontam para um aumento relevante da carga cognitiva à medida que a plataforma passou de um painel informativo de produção para uma ferramenta analítica de consumo energético.

Em especial, a baixa performance nas tarefas analíticas indica limitações de clareza informacional, que podem comprometer:

- diagnósticos técnicos realizados pelo integrador;

- decisões relacionadas à eficiência do sistema;

- conversas comerciais e de orientação com o cliente final.

Esse padrão de baixa performance nas tarefas analíticas nos direcionou a priorizar ajustes na arquitetura da informação e linguagem dos dados antes de avançar para desenvolvimento.

2. Error Rate (interpretação incorreta)

Foram considerados erros quando o usuário:

Confundia autoconsumo com consumo da rede

Interpretava dados de um período diferente do selecionado

Associava incorretamente gráfico e cards laterais

Resultado

A análise mostrou que 3 em cada 5 participantes (60%) cometeram ao menos um erro crítico de interpretação ao executar tarefas analíticas relacionadas a consumo e autoconsumo. Em especial, nas tarefas de autoconsumo, os erros estiveram presentes em mais da metade das execuções, indicando dificuldade recorrente na compreensão da origem e do significado dos dados apresentados. Esses erros foram classificados como críticos por seu potencial de impactar diagnósticos técnicos e levar a decisões operacionais equivocadas por parte dos integradores.

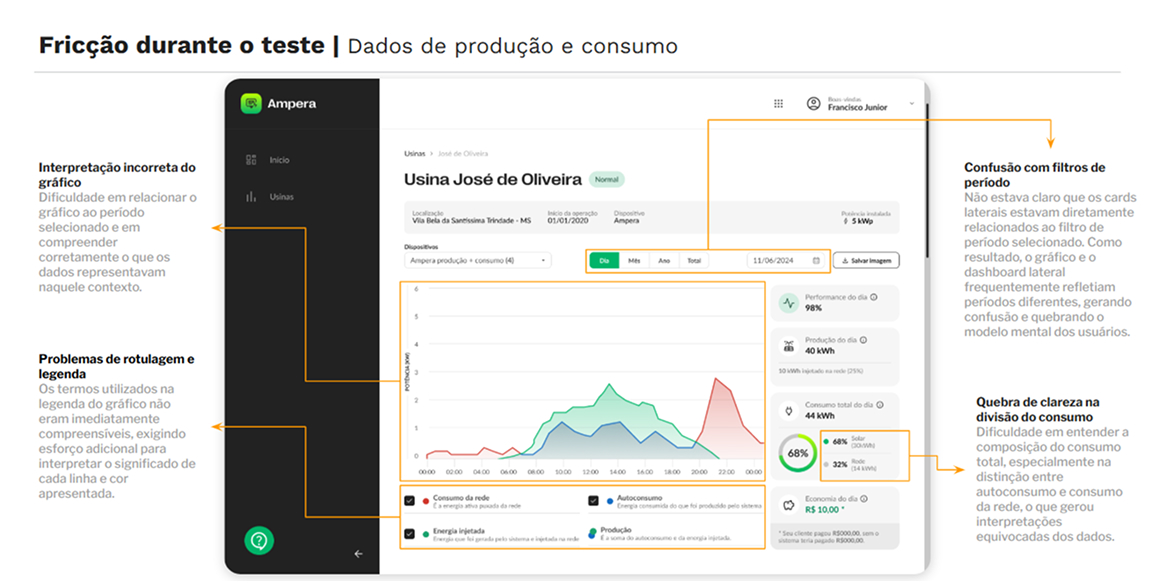

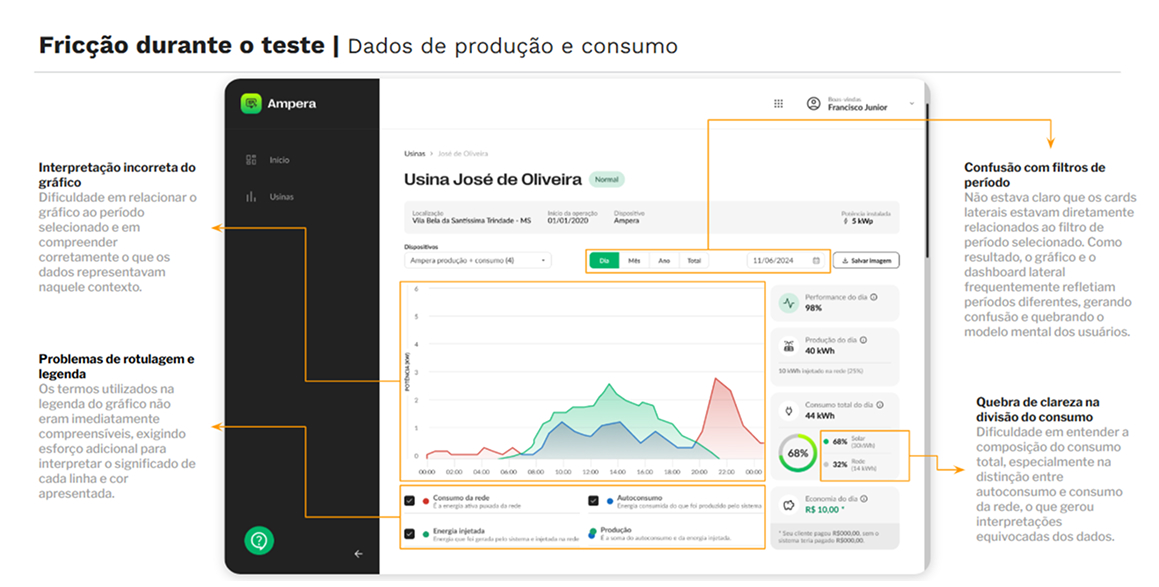

3. Friction Incidence (esforço cognitivo observado)

As fricções foram registradas sempre que os participantes demonstraram hesitação prolongada, apresentaram dificuldade na leitura e interpretação de legendas, fizeram perguntas para validação de valores, períodos ou conceitos, ou realizaram tentativas repetidas de entendimento, como alternar filtros ou revisitar os mesmos elementos da interface. Esses comportamentos foram interpretados como sinais de esforço cognitivo elevado e indicaram limitações na clareza informacional da experiência.

Principais pontos de fricção:

Filtro de período

Fricção presente em 4 de 5 sessões (80%)

Legenda do gráfico

Fricção em 60% das sessões

Relação entre gráfico e cards

Fricção em 70% das interações

Apresentação com os dados consolidados demonstrando pontos de fricção.

4. Clareza Informacional (verbalização correta)

Foi avaliado se o participante conseguia explicar com suas próprias palavras o que estava sendo exibido.

A análise da clareza informacional mostrou que apenas 40% dos participantes conseguiram verbalizar corretamente o que o gráfico representava e explicar de forma coerente a relação entre o período selecionado, a visualização gráfica e os cards de apoio. Nos demais casos, a compreensão dependia de explicações adicionais ou mediação durante o teste, indicando que a interface não comunicava de forma autônoma o significado dos dados apresentados.

- A introdução de dados de consumo aumentou a complexidade sem hierarquia visual suficiente;

- Termos técnicos pouco familiares geraram ambiguidades mesmo entre usuários experientes;

- O desalinhamento temporal entre filtros e visualizações quebrou o modelo mental do usuário;

- A interface permitia “uso”, mas não garantia compreensão correta.

Com base nos dados observados, as decisões de design foram orientadas por métricas comportamentais, priorizando a redução de erros críticos de interpretação (presentes em mais de 60% dos usuários), a diminuição de fricções recorrentes (observadas em mais de 70% das interações) e o aumento da clareza informacional, considerando que apenas 40% dos participantes demonstraram compreensão autônoma dos dados apresentados.

As principais ações adotadas incluíram a reorganização do layout para favorecer uma leitura progressiva, o reposicionamento do filtro de período para alinhar contexto temporal e visualização dos dados, a revisão semântica de títulos e legendas, o aumento de contraste e melhor agrupamento visual das informações, além da inclusão de informações de suporte nos cards laterais, com o objetivo de reduzir ambiguidades e melhorar a compreensão dos dados apresentados.

Gráfico mensal

Gráfico anual

Embora o estudo não tenha sido reaplicado quantitativamente após as melhorias, as decisões visaram diretamente:

- Aumentar o task success rate em tarefas críticas;

- Reduzir erros de interpretação de dados energéticos;

- Diminuir esforço cognitivo em navegação temporal;

- Tornar a leitura de dados mais previsível e confiável.

O teste estabeleceu uma base clara de risco e oportunidade, permitindo evoluir o produto com maior segurança.

Este trabalho demonstra minha capacidade de conduzir pesquisas qualitativas e quantitativas, extrair padrões de comportamento e transformar insights em decisões de design concretas que reduzem risco e apoiam escolhas de produto.